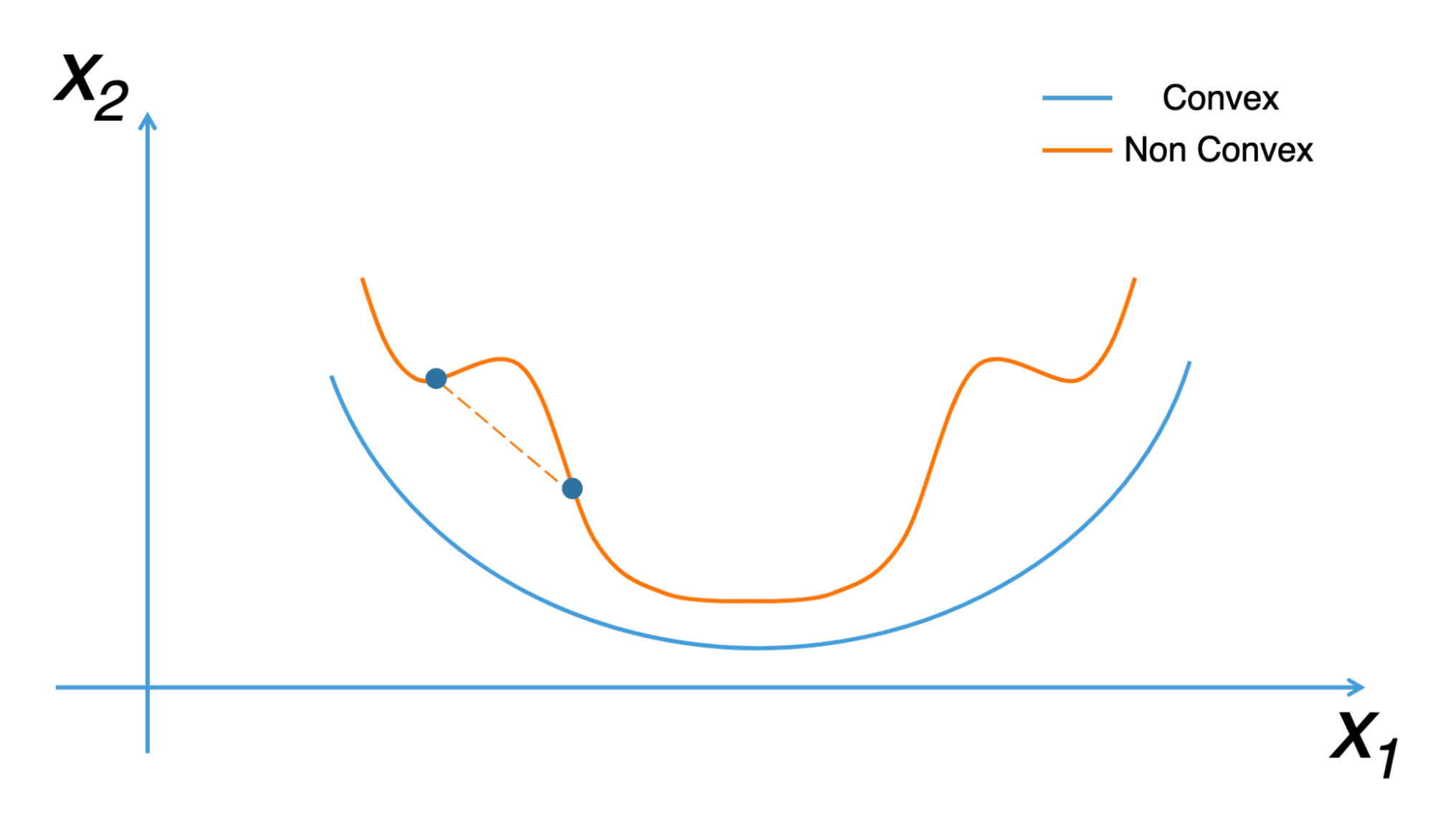

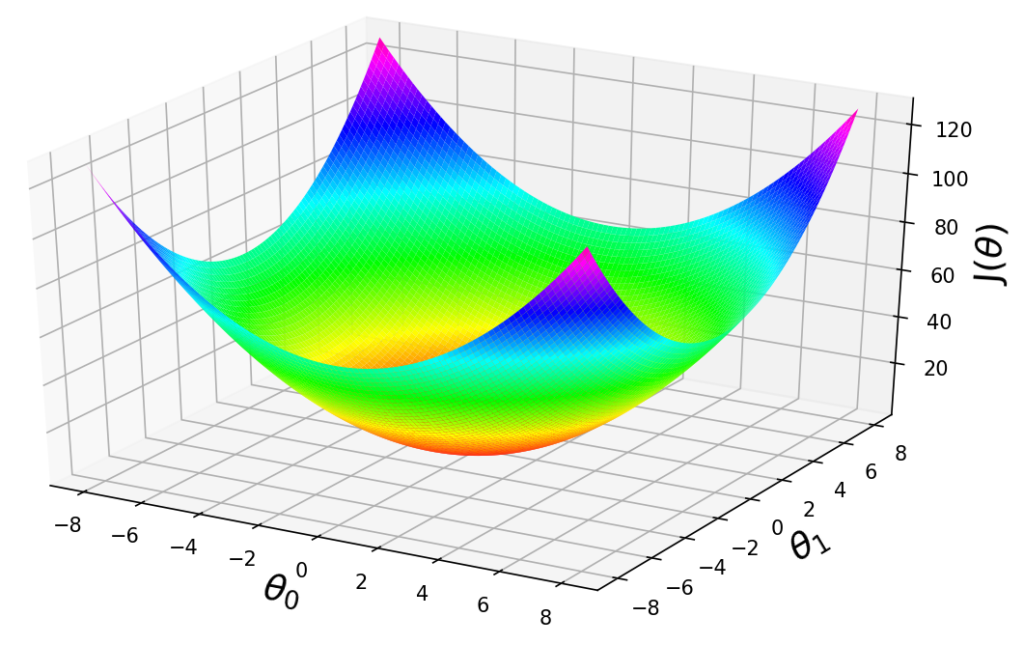

梯度下降(gradient descent)是一种用于优化目标函数(通常是损失函数)的迭代算法。它常用于机器学习和深度学习中的参数优化。梯度下降算法的基本思想是利用目标函数的梯度(即导数)信息,沿着梯度的负方向(下降方向)逐步调整参数,以最小化目标函数。 梯度下降算法的基本步骤如下:

梯度下降算法的基本步骤如下:

初始化参数:选择一个初始参数值(通常是随机值或零值)。

计算梯度:计算目标函数相对于每个参数的梯度(偏导数)。

更新参数:按照梯度的负方向调整参数,更新幅度与学习率(一个正数超参数)成正比。

重复步骤2和3,直到达到预设的迭代次数或满足收敛条件。

数学表示如下:

θ = θ - α * ∇F(θ)

θ:参数向量。

α:学习率,一个正数超参数,控制每次更新的幅度。

∇F(θ):目标函数相对于参数向量θ的梯度(偏导数向量)。

梯度下降算法有几种常见变体:

批量梯度下降(Batch Gradient Descent):在每次迭代中使用整个训练数据集计算梯度。优点是梯度计算准确,收敛稳定;缺点是计算量大,速度慢。

随机梯度下降(Stochastic Gradient Descent,SGD):在每次迭代中随机选择一个样本计算梯度。优点是计算速度快,能很快地逼近最优解;缺点是收敛过程波动较大,可能无法达到最优解。

小批量梯度下降(Mini-Batch Gradient Descent):在每次迭代中使用一小部分训练样本计算梯度。这种方法综合了批量梯度下降和随机梯度下降的优点,计算速度适中,收敛过程较稳定。

在梯度下降的基础上,许多优化算法被开发出来以提高收敛速度和稳定性。这里将介绍一些常见的梯度下降优化技巧和算法:

Momentum:动量法是一种模拟物理中惯性的优化技巧。它通过在梯度更新时加入一个与上一次梯度更新方向相关的项,使参数更新更加平滑。动量项可以看作是历史梯度的指数加权平均,有助于加速收敛,减小振荡。

更新公式:

v_t = γ * v_(t-1) + α * ∇F(θ)

θ = θ - v_t

γ:动量因子,一般取值0.9左右。

Adagrad:Adagrad是一种自适应学习率的优化算法。它通过累积历史梯度的平方和来调整每个参数的学习率。对于梯度较大的参数,其学习率降低;对于梯度较小的参数,其学习率提高。这有助于解决学习率选择和不同参数学习率需求不同的问题。

更新公式:

G_t = G_(t-1) + (∇F(θ))^2

θ = θ - α * (∇F(θ) / √(G_t + ε))

G_t:历史梯度平方和矩阵。

ε:一个很小的正数,防止分母为零。

RMSProp:RMSProp算法是Adagrad的改进版本。它通过指数加权平均的方式计算历史梯度平方和,解决了Adagrad学习率可能过早衰减的问题。

更新公式:

G_t = β * G_(t-1) + (1 - β) * (∇F(θ))^2

θ = θ - α * (∇F(θ) / √(G_t + ε))

β:梯度平方和的衰减因子,通常取值0.9。

Adam:Adam(Adaptive Moment Estimation)算法结合了Momentum和RMSProp的优点,既有动量项,又有自适应学习率。它通常能在很多任务中取得较好的收敛效果。

更新公式:

m_t = β1 * m_(t-1) + (1 - β1) * ∇F(θ)

v_t = β2 * v_(t-1) + (1 - β2) * (∇F(θ))^2

m_t' = m_t / (1 - β1^t)

v_t' = v_t / (1 - β2^t)

θ = θ - α * (m_t' / √(v_t' + ε))

β1:动量衰减因子,通常取值0.9。

β2:梯度平方和的衰减因子,通常取值0.999。

ε:一个很小的正数,防止分母为零。

m_t:动量项。

v_t:梯度平方和项。

m_t' 和 v_t':偏差校正后的动量项和梯度平方和项。

以上是几种常见的梯度下降优化技巧和算法,它们在机器学习和深度学习中广泛应用,有助于提高模型训练的收敛速度和稳定性。在实际应用中,选择合适的优化算法需要根据具体任务和数据集的特点进行尝试和调整。同时,超参数(如学习率、动量因子等)的选择也会影响优化效果,需要进行合适的调整。在实际应用中,还可以结合动量、自适应学习率等技巧进一步优化梯度下降算法,提高收敛速度和稳定性。例如,常见的优化器如Adam、RMSProp、Adagrad等,都是在基本的梯度下降算法上进行改进的。

www.0574web.net 宁波海美seo网络优化公司 是网页设计制作,网站优化,企业关键词排名,网络营销知识和开发爱好者的一站式目的地,提供丰富的信息、资源和工具来帮助用户创建令人惊叹的实用网站。 该平台致力于提供实用、相关和最新的内容,这使其成为初学者和经验丰富的专业人士的宝贵资源。声明本文内容来自网络,若涉及侵权,请联系我们删除! 投稿需知:请以word形式发送至邮箱18067275213@163.com

站长 大佬辛苦了

靠谱的少呀

这个有点意思啊。 我感觉现在标题的重要性越来越弱。我做的这行,网络加速器,排在第一的标题没有这个词。。。